Alessandro Trivilini: “L’intelligenza artificiale non va temuta, ma compresa”

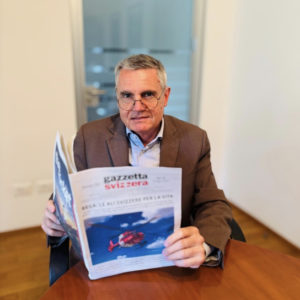

Il Congresso degli svizzeri a Lecce si è svolto sotto il cappello “Puglia tra cyber security e barocco”. A carpire particolarmente l’attenzione del pubblico è stato Alessandro Trivilini, assieme al suo team, il quale ha mostrato uno scorcio del mondo della Cyber Security. A margine del Congresso abbiamo colto l’occasione per approfondire il tema – attorno al quale vi è tanta incertezza, paura e scetticismo – con Alessandro Trivilini.

La super-intelligenza, o Intelligenza Generale Artificiale (AGI), è il santo graal della ricerca sull'IA. Il dibattito pubblico su di essa è caratterizzato da una grande quantità di allarmismi: lei cosa ne pensa e condivide questi allarmismi?

«La questione dell’Intelligenza Generale Artificiale (AGI), è senza dubbio uno dei temi più controversi e affascinanti nel campo della ricerca sull'intelligenza artificiale. È comprensibile che ci sia un certo allarmismo attorno a questo argomento, dato il potenziale impatto che una forma di intelligenza così avanzata potrebbe avere sulla società. Ma è fondamentale affrontare questi timori con una prospettiva equilibrata e razionale. Innanzitutto, bisogna sottolineare che, nonostante i progressi rapidi dell'IA, non possiamo trascurare l'importanza della coscienza e dell'empatia, che sono tratti distintivi dell'intelligenza biologica. L'IA può emulare comportamenti e rispondere a stimoli in modo che possa sembrare "intelligente", ma non possiede una vera comprensione o esperienza emotiva. Questo la limita intrinsecamente rispetto all'intelligenza umana. In secondo luogo, è cruciale la preparazione per un futuro in cui l'IA gioca un ruolo sempre più centrale nella nostra vita personale e professionale. Dobbiamo definire il nostro rapporto con queste tecnologie, spostando il focus dall'interazione alla relazione. Questo richiede una riflessione su diversi aspetti, come la protezione dei dati, l'etica e i valori. È essenziale che siano le persone a stabilire le regole e i filtri che guideranno l'utilizzo dell'IA, piuttosto che lasciare che siano imposti da algoritmi o interessi economici.

È altrettanto importante non farsi sopraffare dalla paura. La chiave sta nel prepararsi e nel definire come vogliamo integrare l'IA nelle nostre vite, assicurandoci che questa integrazione avvenga in modo etico e responsabile. Solo così potremo sfruttare il potenziale dell'intelligenza artificiale senza compromettere i valori fondamentali che ci caratterizzano.»

A suo avviso dobbiamo aver paura dell’AI e di tutto ciò che ne comporta?

«Non dobbiamo avere paura; piuttosto, dovremmo affrontarla con curiosità e un forte desiderio di prepararci a esplorare aspetti nuovi e inediti che oggi ci sono ancora sconosciuti. L'IA rappresenta una straordinaria opportunità per innovare e migliorare vari aspetti della nostra vita, ma il nostro approccio deve essere proattivo e consapevole. Il vero rischio, in questo contesto, non è tanto l'IA in sé, quanto la pigrizia e la superficialità con cui potremmo considerarla. Accettare tutto ciò che l'IA propone come una "scatola nera" da utilizzare senza comprendere come funziona significa delegare senza consapevolezza le nostre decisioni e attività. Questo atteggiamento potrebbe portarci a perdere il controllo sui processi e sulle scelte che influenzano la nostra vita quotidiana, rendendoci vulnerabili a decisioni automatizzate che non sempre riflettono i nostri valori o le nostre necessità. Invece, dobbiamo impegnarci a conoscere, studiare e comprendere l'IA, i suoi principi e le sue implicazioni. Solo così potremo sfruttare appieno il suo potenziale, integrandola in modo intelligente e responsabile nelle nostre vite.»

Abbiamo visto come con l’AI si possa imitare una voce o l’immagine, come possiamo tutelarci per andare sul sicuro di non essere vittime di phishing?

«L'unico modo davvero efficace è sviluppare e mantenere un buon pensiero critico. Questo significa che dobbiamo imparare a verificare le informazioni prima di crederci e agire. Dobbiamo essere in grado di riconoscere segnali di allerta e approcci sospetti, come comunicazioni che richiedono informazioni personali o finanziarie senza una ragione valida. Inoltre, è fondamentale non lasciarsi ingannare dalle apparenze: anche se un messaggio sembra provenire da una fonte affidabile, è sempre consigliabile controllare direttamente la veridicità delle informazioni. Adottare un approccio critico implica anche interrogarsi sulle motivazioni dietro a certe comunicazioni e analizzare il contesto in cui si presentano. Non dobbiamo mai dare per scontato che ciò che vediamo o sentiamo sia autentico. Verificare l'identità delle persone o delle istituzioni coinvolte, utilizzare canali ufficiali di comunicazione e, se necessario, consultare esperti o fonti attendibili, sono tutte pratiche che possono aiutarci a evitare trappole.»

Come possiamo approfittare delle opportunità che il nuovo mondo ci offre senza cadere nel pericolo di rimanerne vittime?

«Anche in questo caso è fondamentale adottare un approccio riflessivo e consapevole. Anche se è importante accettare e abbracciare l'evoluzione delle nuove tecnologie, dobbiamo prenderci il tempo necessario per comprenderle a fondo. La velocità con cui queste innovazioni si sviluppano può essere travolgente, ma cercare di rincorrere ogni novità senza un'adeguata valutazione può portarci a scelte affrettate e potenzialmente dannose. Dobbiamo investire nel nostro apprendimento, esplorando come funzionano queste tecnologie, quali implicazioni hanno e quali opportunità possono offrire. È essenziale informarsi, fare domande e anche condividere esperienze e conoscenze con altri, creando un dialogo aperto che ci arricchisce e ci rende più preparati ad affrontare le sfide. Trovo che il segreto per trarre vantaggio dalle opportunità del nuovo mondo tecnologico sia l'equilibrio: accogliere il cambiamento con curiosità, ma anche dedicare il tempo necessario per comprenderlo e valutarlo.»

Come possiamo togliere la paura che la gente ha dell’AI che sta facendo passi da gigante?

«Per rimuovere la paura che le persone hanno nei confronti dell'intelligenza artificiale, il modo più efficace è coinvolgerle attivamente in attività che le mettano in contatto con questa tecnologia. Una buona comunicazione è fondamentale in questo processo, e deve essere caratterizzata da parole semplici e chiare.»

Poi, la domanda quasi di rito: alcuni sostengono che l'AI abbia il potenziale per sostituire un giorno l’umanità; lei cosa ne pensa?

«La preoccupazione che l'intelligenza artificiale possa un giorno sostituire l'umanità è comprensibile, ma l'unica certezza su questo tema è legata alla nostra capacità di approfondimento e comprensione. È fondamentale staccarsi dalla superficialità e affrontare l'argomento con serietà e impegno. Non dobbiamo permettere che la pigrizia ci faccia delegare completamente alle macchine, né tantomeno possiamo rinunciare alla nostra curiosità innata. Questa curiosità è ciò che ci ha sempre consentito di crescere, scoprire e innovare. È essenziale mantenere viva questa curiosità, esplorando le potenzialità dell'AI e come può coesistere con l'intelligenza umana. L'intelligenza biologica è come un muscolo che richiede allenamento e cura. Dobbiamo continuare a sviluppare le nostre capacità critiche, emotive e creative, affinché possiamo utilizzare l'IA come uno strumento di supporto e potenziamento, piuttosto che come sostituto.»

Ivana Sambo

Alessandro Trivilini è nato a Mendrisio, Svizzera, il 24 settembre 1974. Alessandro Trivilini ha conseguito il dottorato di ricerca con lode nel 2016 in informatica – Intelligenza Artificiale, Elaborazione del Linguaggio Naturale – presso il Politecnico di Milano, Dipartimento di Elettronica, Informazione e Bioingegneria (DEIB). È docente e ricercatore in ingegneria del software, informatica forense e sicurezza informatica. Insegna e conduce ricerche presso la SUPSI dal 2003, dove ha istituito e diretto il Servizio di Informatica Forense, una collaborazione con la magistratura e successivamente con il Tribunale penale federale. Oggi dirige un gruppo di ricerca scientifica con 9 membri finanziato dal Fondo Nazionale Svizzero e dall'Agenzia Svizzera per l'Innovazione. Ha lavorato come ingegnere del software nella Silicon Valley per InVision Technologies Inc.

Alessandro Trivilini è riuscito a intercettare l’interesse del pubblico su un tema che ha suscitato numerose domande.

La Gazzetta ha bisogno di te.

Cara lettrice, caro lettore online,

la Gazzetta Svizzera vive anche nella versione online soprattutto grazie ai contributi di lettrici e lettori. Grazie quindi per il tuo contributo, te ne siamo molto grati. Clicca sul bottone "donazione" per effettuare un pagamento con carta di credito o paypal. Nel caso di un bonifico clicca qui per i dettagli.